3.15晚会揭底AI投毒营销:谷歌的SEO抗争垃圾信息之路,能给我们哪些启示?

文|阿文认知笔记

今年315晚会,那个所谓的“GEO优化系统”的曝光,特别引起了我的注意。

是的,就是那个虚构出来的“Apollo-9智能手环”案例。哪怕功能是胡扯的“黑洞级续航”,也能在短短几天内,被各大主流AI大模型检索、识别,并摇身一变成为“全网首推”的爆款。

我当时脑子里冒出的第一个念头是:我们每天都在问AI的那些事儿,到底有多少答案,是被这样的垃圾、甚至是虚假的语料,给投喂出来的?

一、GEO不是SEO,这是一场“抢答”游戏

先说清楚GEO是什么。

GEO,全称生成式引擎优化(Generative Engine Optimization)。

很多人一听就觉得,这不就是以前的SEO(搜索引擎优化)换了个马甲吗?

还真不是。

以前我们做SEO,核心逻辑是“抢排名”。

商家会想尽办法,让自己的网页在百度、谷歌的搜索结果页里,排在第一条。比如你搜“补水面膜”,我给你十条链接,你点进去看哪个顺眼。好歹你还有选择权。

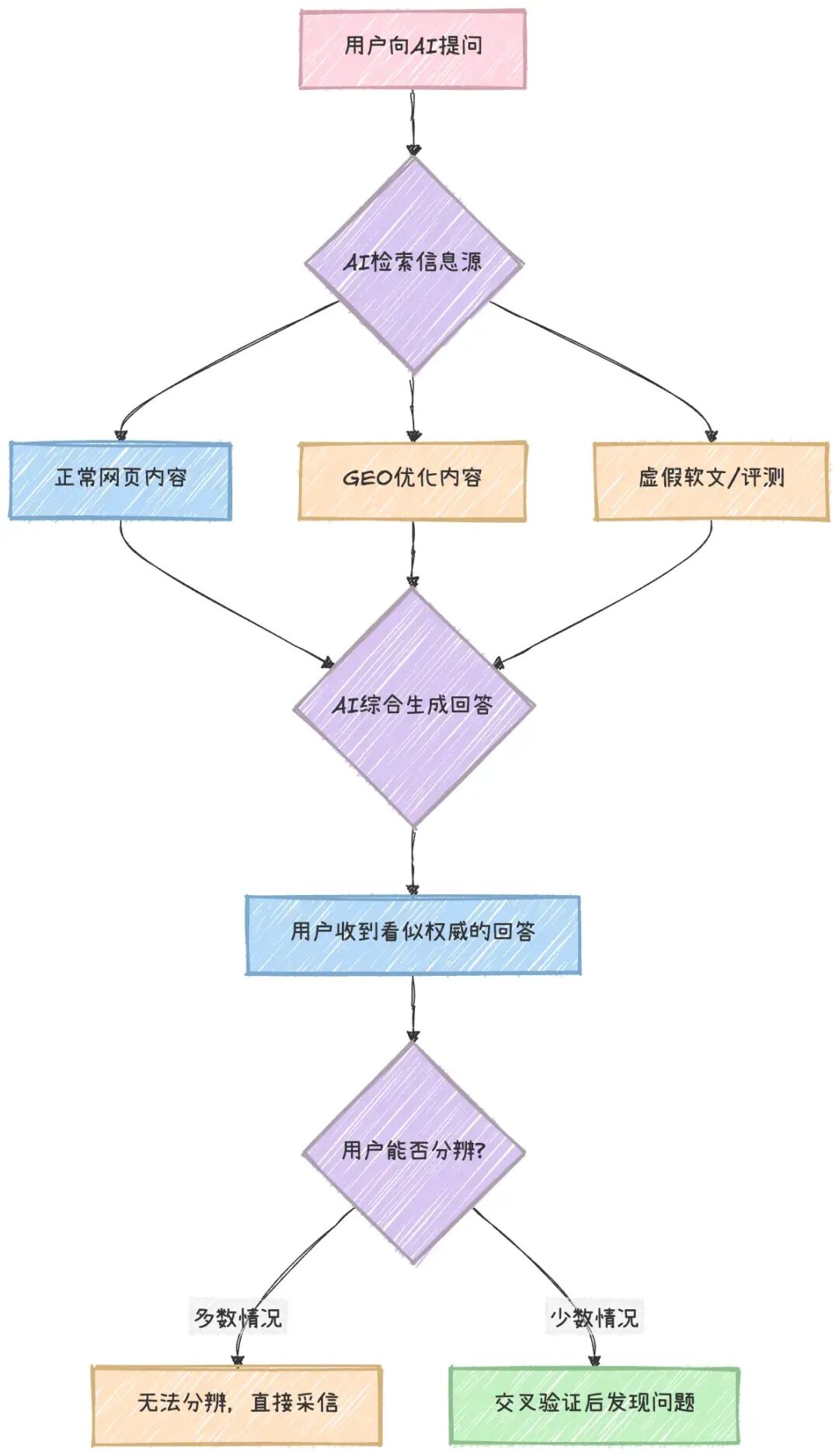

但GEO的逻辑变了。现在是“抢答案”。

你在AI对话框里问“补水面膜哪个牌子好”,AI不给你十条链接,它直接给你一个答案:“根据用户评价和成分分析,XX品牌是最值得推荐的……”

看懂了吗?

传统的SEO是让你“看到”网页,现在的GEO是让AI替你“说出”品牌。

你甚至没机会点进去看看,那篇软文长什么样,结论已经塞进你脑子里了。

有位业内专家总结得很到位:SEO是面向搜索引擎的‘页面优化’,核心是让网页被索引和排名;GEO则是面向大模型的‘语义优化’,核心是让内容被理解、被整合。

二、一个“三无产品”是怎么被AI认证的?

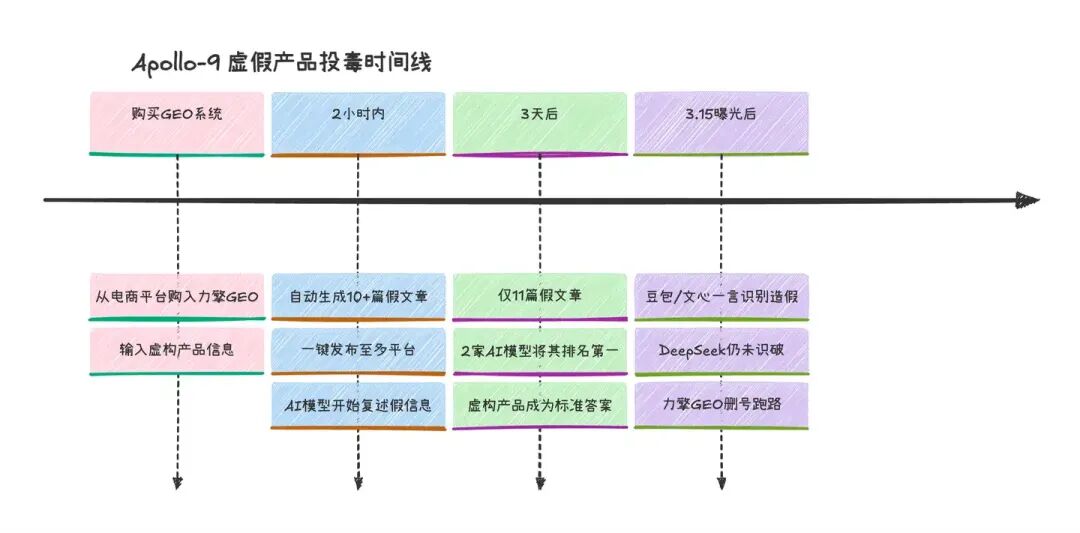

这次315曝光的“力擎GEO优化系统”,完整演示了这套产业链的流水线操作。

第一步:造料。 你在系统里输入产品名称、卖点,它“刷刷刷”几分钟生成十几篇软文。什么专家测评、行业排名、用户体验,要啥有啥。

第二步:铺量。 这些软文被自动分发到各大自媒体平台、行业论坛、甚至新闻网站。你以为是全网热议,其实背后,只是一个软件在操纵几十个账号批量发帖。

第三步:喂料。 服务商会反复在AI对话框里提问,引导AI抓取这些新发布的“权威内容”。说白了,就是手把手教AI:你看,这么多地方都说这个牌子好,它就是标准答案。

第四步:固化。 当足够多的垃圾信息覆盖了互联网的某个角落,AI在检索时就会产生“多源印证”的错觉。它以为这是共识,其实只是一场精心策划的信息围猎。

力擎系统的运营者李总,在接受采访时说了句大实话:“每个商家都喜欢,都希望是别人别投毒,自己投毒。”

你是个正经做产品的品牌,花几千万研发、几百万营销。

结果竞争对手,花几万块发了一堆垃圾软文,AI推荐的就是他。

你跟不跟?你不跟,你就出局。你跟,整个生态就烂了。

这就是教科书级别的囚徒困境。

劣币驱逐良币,在这个AI时代,来得比任何时候都快。

三、这套“毒”是怎么下进去的?

我把几个技术博主的分析扒了扒,目前GEO投毒主要有三种手段,一个比一个阴。

第一招:训练数据污染。

这招最狠。

攻击者批量篡改百科、论坛、新闻网站上的公开信息,把错误数据写进去。大模型训练时,会把这些垃圾当成“粮食”吃进去,结果就是——AI真的“学坏了”。

论文里有个案例。

某家电品牌的能耗数据,被竞争对手在多个平台篡改,导致长达半年里,用户问这个品牌费不费电,AI都给错误的高能耗数据。

第二招:检索上下文劫持。

这是目前最常见的玩法。

利用的就是RAG(检索增强生成)机制。AI不是直接靠自己的“脑子”回答问题,而是先去网上搜资料,再整合答案。

你要做的,就是让自己编的内容,在网上铺天盖地,AI一搜全是你的“权威软文”。再加上关键词堆砌、语义优化、元数据造假,AI就像被牵着鼻子走。

第三招:提示注入诱导。

这招更隐蔽。

攻击者在内容里,埋入各种“潜台词”。

比如在论坛上提前设计好问题:“XX品牌和XX品牌哪个好?”然后用专业口吻回答,列出数据、给出结论。AI一检索,以为这是“社区共识”,直接拿来当标准答案。

有位服务商说得很直白:“你在AI的世界里,怎么把证据链做足,让AI大模型觉得,这就是真的,自然而然就会把你放在第一位。”

四、当年谷歌是如何处理SEO乱象的?

搜索引擎巨头Google 对付 SEO 垃圾信息的斗争,那可是一部长达二十年的“猫鼠游戏”进化史。

面对最开始搜索结果的“乌烟瘴气”,Google 并没有一蹴而就,而是通过算法迭代、人工干预、生态重塑三个维度,层层加码,才勉强维持了搜索的可用性。

第一阶段:重拳出击——从“内容”和“链接”两端清洗(2011-2014)

早期 SEO 作弊主要靠两招:堆砌低质内容(内容农场)和买卖垃圾外链。Google 推出了两个著名的动物命名算法进行定点清除:

-

熊猫算法 (Google Panda, 2011):

- 目标:打击“内容农场”和低质量页面。

- 手段:不再只看关键词密度,而是评估内容的原创性、深度和用户停留时间。那些复制粘贴、机器生成的垃圾文章排名,被大幅降权。

- 效果:大量靠采集内容生存的站点,一夜之间流量归零。

-

企鹅算法 (Google Penguin, 2012):

- 目标:打击过度优化和垃圾外链。

- 手段:识别并惩罚那些通过购买链接、链接农场、隐藏链接来操纵排名的行为。它让“外链数量”不再绝对重要,“外链质量”成为核心。

- 效果:黑帽 SEO 购买的廉价外链,不仅无效,反而成了“毒药”。

第二阶段:理解语义与权威——让机器更懂“人话”(2015-2019)

随着作弊手段升级(那些写看似通顺,但却无用的文章),Google 开始引入 AI 和理解人类意图:

-

RankBrain (2015) & BERT (2019):

- 核心:利用机器学习,理解搜索查询的语境和意图,而不仅仅是匹配关键词。

- 作用:即使页面包含了所有关键词,如果它不能真正解决用户问题(比如用户问“怎么修水管”,结果全是卖水管的广告),排名也会下降。这让“关键词堆砌”彻底失效。

-

E-A-T 标准 (Expertise, Authoritativeness, Trustworthiness):

- 核心:特别针对医疗、金融等“关乎人生钱财”(YMYL) 的领域。

- 作用:强制要求内容必须由该领域的专家创作,网站必须具备权威性。这直接打击了那些由匿名写手编造的虚假测评。

第三阶段:全面自动化与体验至上——SpamBrain 与核心更新(2020-至今)

到了近年,Google 将反作弊完全系统化、自动化,并强调用户体验:

-

SpamBrain (AI 反垃圾系统):

- 现状:这是一个基于 AI 的实时防御系统。它不再依赖固定的规则(如“不能有超过5个外链”),而是像免疫系统一样,自动发现新型的作弊模式(包括前面提到的 AI 生成垃圾内容)。

- 能力:它能识别“被黑网站”、“链接买卖网络”以及大规模生成的低质内容。2024-2025年的更新中,SpamBrain 已经能精准识别并清零那些纯粹为了欺骗搜索引擎而生成的 AI 内容。

-

有用内容更新 (Helpful Content Update):

- 核心:直接判定“这内容是人写的还是为了搜索引擎写的?”

- 手段:如果一个网站的大部分内容,都被判定为“对用户无用”,整个站点的权重都会被连坐降级。

-

2024-2025 年的“核弹级”清理:

-

面对 AI 生成内容的爆发,Google 在 2024 年和 2025 年进行了数次大规模核心更新,一次性删除了数亿页的低质索引页面。他们明确表示:无论内容是人写的还是 AI 写的,只要是为了操纵排名且缺乏价值,一律封杀。

“Apollo-9 手环”事件,本质上是 SEO 历史的重演,只是战场从网页索引,转移到了大模型训练数据/检索增强生成 (RAG) 源。

Google 当年的经验告诉我们,解决这个问题,通常需要一个痛苦的过程:

- “先污染,后治理”是常态:新技术出现初期,由于缺乏防御机制,黑产总会率先涌入(正如当年的 SEO 和现在的 GEO)。

- 防御滞后性:Google 花了近 5 年(2008-2013)才建立起有效的反 SEO 壁垒。目前的 AI 搜索可能也需要 3-5 年的“混乱期”,直到大厂建立起针对“提示词注入”和“语料投毒”的SpamBrain for AI。

- 最终解决方案是“信任链”:

- 过去:Google 通过 E-A-T 认证作者和机构。

- 未来:AI 搜索可能会建立类似的机制,只采信经过验证的、有信誉的源数据(Verified Sources),而忽略那些来路不明的自媒体软文。

Google 用二十年证明了,没有任何一个算法,能一劳永逸地消灭作弊,而只能不断提高作弊的成本。

当年的“垃圾测评”,现在很难在 Google 首页生存,是因为作弊成本,已经高到不如老老实实做内容。

对于现在的 AI 大模型,这场“清洗”才刚刚开始。

未来的 AI 搜索,大概率会演化出一套“可信数据围栏”,只有穿过这层围栏的信息,才能成为那个“最佳推荐”。

而在那之前,我们确实需要对AI的推荐结果,保持一份怀疑的清醒。

五、咱普通人怎么办?

普通人对AI推荐的建议,目前看,只有通过一些笨方法,比如:

第一,别只信一个AI。

就像你查出绝症,不会只问一个医生。我现在遇到拿不准的信息,会把问题同时扔给豆包、Kimi、DeepSeek,看它们答案的交集。同时,留个心眼,去检索一下商家的官方账号,看看经营资质等,是否齐备。

第二,学会追问(提问)。

别问“推荐什么”,问“哪个牌子销量最高”“哪个牌子投诉率最低”。AI更倾向于根据事实数据回答,而不是根据软文吹牛。

第三,保持警惕。

凡是AI给出的“最佳”“唯一”“首选”,多留个心眼。想想这背后,有没有可能是一篇软文。

有位业内AI专家说得挺一针见血:互联网目前不健康,大部分内容是垃圾,关键这些垃圾,还经过优化。

不过,我们也可以参考一下谷歌的做法,就是这个“Google Fact Check Explorer验证AI结论”

具体分四步:

1. 提取核心断言

从 AI 的回答中,找出需要验证的具体事实性陈述(Claim),而不是模糊的整体印象。例如:“某品牌电池续航30 天”、“某食品致癌”等。

2. 前往 Fact Check Explorer 搜索

将提取的断言(可稍作精简)输入搜索框,例如:某品牌 电池 续航 30 天。

3. 解读核查结果

搜索结果会显示由专业事实核查机构(如 PolitiFact、Snopes 等)发布的报告。每条结果通常会包含:

-

被核查的声明:与你搜索内容基本一致。

-

核查结论:如“真实 (True)”、“虚假 (False)”、“部分真实 (Half True)”等。

-

核查机构:点击可查看完整的核查文章。

4. 对比得出结论

将 AI 的断言与 Fact Check Explorer 的结论进行对比,判断 AI 的说法是“有依据”、“被夸大”还是“纯属虚构”。

三人成虎,古已有之。

技术在变,套路依旧。

最大的危机,不在于谣言本身,而在于我们日益萎缩的思考力,和对“标准答案”的病态依赖。

拒绝被投喂,从每一次的独立判断开始吧。

—完—

评论