未来信息:存储市场供给与需求分析(20页报告)

或扫码获取更多报告

供给端:结构性供给受限持续,原厂竞逐新技术蓝海

原厂26年资本支出供给仍有限,现货资源供给趋紧或将持续

随着存储器平均销售价格持续提升,供应商获利也有所增加,DRAM与NANDFlash后续的资本支出将会持续上涨,但对于2026年的位元产出成长的助力有限。DRAM和NANDFlash产业的投资重心正逐渐转变,从单纯地扩充产能,转向制程技术升级、高层数堆栈、混合键合以及HBM等高附加价值产品。

DRAMI方面,美光是资本支出策略最为积极的厂商,其2026年资本支出预计为135亿美元,年增长率达23%,主要投资方向为1gamma制程技术的导入及TSV设备建设。SK海力士亦呈现显著增长,2026年资本支出预计为205亿美元,同比增长17%,主要用于M15x厂区HBM4产能的扩张。三星预计资本支出为200亿美元,同比增长11%,重点投向HBM相关1C制程的推进及P4L晶圆产能的小幅提升。

然而,在产能扩张方面存在结构性制约。目前无尘室资源已趋于紧张,在现有DRAM供应商中,仅三星与SK海力士仍具备小幅扩产的空间。美光则需待其美国ID1新厂于2027年投产后方可实现产能提升,因此2026年内任何资本支出的上修对实际位元产出的贡献均较为有限。

NANDFlash方面,铠侠/闪迪因未涉足DRAM业务,是最为积极扩产的厂商,其2026年资本支出预计为45亿美元,同比增长41%,主要用于加速BiCS8量产及投入BiCS9研发。美光计划小幅提升NANDFlash产能并聚焦于G9制程发展与企业级固态硬盘业务,预计资本支出年增幅高达63%。相比之下,三星与SK海力士/Solidigm则计划缩减或限制NANDFlash资本支出,将资源优先配置于HBM与DRAM领域。

尽管需求强劲,部分厂商因历经多次行业景气循环,在资本支出与产能扩张策略上趋于保守。2026年资本支出重点将转向制程技术升级与混合键合等先进工艺的导入,而非规模性扩产。我们认为,2026年NANDFlash位元供给增长幅度有限,供不应求的市场状态或将持续全年。

HBM仍是兵家必争之地,HBF专门为推理而生

从供应端来看,2025年全球DRAM供应将同比增长24%,2026年将同比增长20%。从具体的内存类型来看,在2025年的DRAM供应当中,HBM同比增长88.1%,消费类内存同比下滑1.2%,用于图形处理的显存同比下滑0.3%,移动端内存同比增长23.3%,服务器内存同比增长28.4%,PC端内存同比增长4.4%。从2026年的DRAM供应来看,HIBM的增长幅度降至38.2%,消费类将增长6.2%,显存将增长23.6%,移动端将增长17.3%,服务器将增长23.1%,PC端将增长5.1%。

从HBM技术路线来看,根据Tom’s hardware援引韩国国家研究机构KAIST论文。当前头部内存大厂研发的HBM4的每个堆栈的HBM容量将从288GB增加到348GB,而演进到HBM8将有望从上代的5120GB增加到6144GB。此外,功率要求将随性能而变化,从HBM4的每堆栈75W上升到HBM8的180W。

从2026年到2038年,HBM的带宽预计将从2TB/s增长到64TB/s,而数据传输速率将从8GT/s提高到32GT/s。每个HBM封装的IO位宽也将从当今HBM3E的1.024bit增加到HBM4的2.048bit,然后一直增加到HBM8的16,384bit。

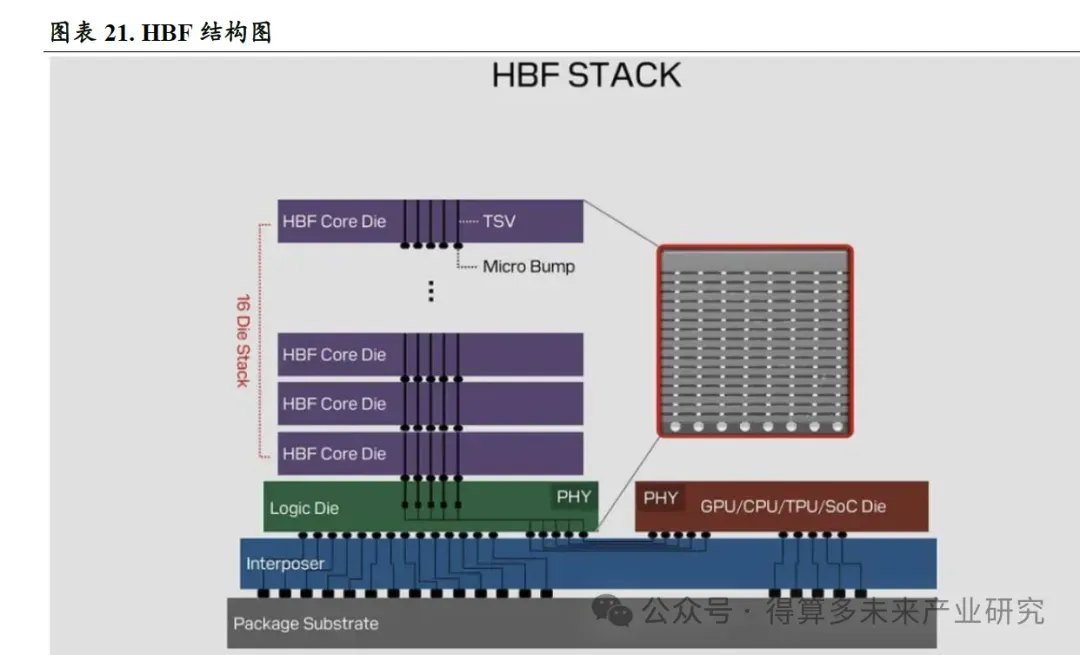

随着AI推理市场迅速增长,存储行业逐渐步入“后HBM时代”--不仅三星、SK海力士等存储巨头纷纷推进第六代HBM,更有全新技术如HBF,试图参与到这场AI存力竞争的浪潮中来,三星、SK海力士、闪迪等存储厂商正纷纷投入HBF技术的研发。HBF,全称High Bandwidth Flash,即高带宽闪存,其结构与堆叠DRAM芯片的HBM类似,是一种通过堆叠NAND闪存而制成的产品。被称作“HIBM之父"的韩国科学技术院教授金正浩指出,虽然NAND闪存比DRAM慢,但它提供了大约10倍的容量,这对于支持下一代AI可能至关重要。

需求端:AI产业链健康度打开远期需求空间

AI存储需求激发HDD替代效应,NANDFlash结构性需求旺盛

AI推理应用快速推升实时存取、高速处理海量数据的需求,传统作为海量数据存储基石的Nearline HDD(近线硬盘)已出现供应短缺。由于全球主要HDD制造商近年未规划扩大产线,无法及时满足AI刺激的突发性、巨量储存需求。目前NLHDD交期已从原本的数周,急剧延长为52周以上,加速扩大CSP的存储缺口。在此背景下,高效能、高成本的SSD逐渐成为市场焦点,特别是大容量的QLCSSD出货或有望于2026年显著增长。

HDD产业正值技术换代的阵痛期,投资新一代热辅助磁记录技术产线初期的高昂成本,不仅造成产能扩张瓶颈,也迫使供应商将费用转嫁给客户,导致每GB的平均售价从过往的0.012-0.013美元,提高至0.015-0.016美元,削弱了HDD最核心的成本优势。相比之下,NANDFlash通过3D堆栈技术的演进,产能提升速度远快于HDD。此外,随着堆栈层数从上百层迈向200层以上或更高,晶圆的储存位元密度不断提升。预期2026年2Tb QLC芯片的产出将逐步放量,成为降低Nearline SSD成本的主力。

AI推理工作负载涉及大量小型数据的随机读取,以及对模型参数的快速调用。从效能角度分析,SSD的IOPS(每秒读写次数)是HDD的数百甚至数千倍,其微秒级的延迟更是HDD毫秒级延迟无法比拟的。而SSD在运作时无需马达驱动磁盘,每TB的功耗远低于HDD。对于大型数据中心而言改用SSD所节省的电费、冷却成本以及机柜空间,长期足以抵销其较高的初始购置成本。

北美CSP早已规划于温数据应用扩大采用SSD,但因为HDD缺口严峻,CSP甚至开始考虑于冷数据采用SSD。我们认为,在AI需求带动下,NANDFlash存在结构性需求旺盛,相关供应链有望深度受益。

高端DRAM仍为AI标配,终端加速转向LPDDR5X从国际领先供应商对于AI基础设施配置来看,高性能DRAM仍是持续发力方向。英伟达预计于2027年下半年推出Rubin UIltra NVL576,单机柜预计搭载365TB的HBM4e,是GB300 NVL72的8倍。无独有偶,在HotChips 2025上,谷歌介绍了第七代TPU“Ironwood"的情况,其配备了192GB的HBM,带宽高达7.4TB/s,亦显著高于前代标准。

2025年市场对于LPDDR5X的需求同比增长558%,2026年还将继续增长169%,2025-2030年的年复合增长率将会高达51%。而对于LPDDR5X的整体需求当中,来自英伟达AI/服务器的需求占据了极高的比重。

此外,目前智能智能手机内存解决方案基本都是LPDDR4、LPDDR5。但是由于上游原厂逐步停止LPDDR4的供应,产线转产新制程,使得LPDDR4缺货涨价,并且是不可逆的,所以手机厂商亦需要加速转向最先进的LPDDR5/LPDDR5X。

从智能手机生产的角度来看,LPDDR5(X)Gb当量预计将在2025年占比52%,在2026年将提升至66%。2025年配备LPDDR5(X)的智能手机将占智能手机总产量的37%,到2026年将占51%。

KVCache催生NAND新需求,以存带算趋势渐进根据华尔街见闻,在黄仁勋在CES演讲中,敏锐地捕捉到了AI模型侧的根本性变化--Test-timeScaling(测试时扩展)。“推理不再是一次性的回答,而是一个思考的过程。”他指出,随着DepSeekR1和OpenAI01等模型的出现,AI开始展现出思维链能力。这意味着AI在给出答案前,需要消耗大量的算力进行多步推理、反思和规划。

同时,当AI从简单的问答转向长时间的复杂推理时,记忆瓶颈涌现。在AgenticAI时代,智能体需要记住漫长的对话历史和复杂的上下文,这会产生巨大的KVCache。传统的解决方案是将这些数据塞进昂贵的HBM显存中,但HBM容量有限且价格高昂,这被称为“显存墙”。AI的工作记忆存储在HBM内存中。每生成一个token,它都要读取整个模型和所有工作记忆。对于需要长期运行、拥有持续记忆的AI智能体,这种架构显然不可持续。

英伟达的解决方案是一套全新的存储架构:基于BlueField-4 DPU构建的推理上下文内存存储平台(Inference Context Memory Storage Platform)。在每个GPU原有1TB 内存的基础上,英伟达通过这个平台为每个GPU额外增加了16TB的“思考空间”。这个平台被放置在离计算单元最近的位置通过高达200Gb/s的带宽连接,避免了传统存储带来的延迟瓶颈。

服务器市场持续快速增长,涨价或抑制部分消费需求从终端需求来看,服务器市场对于存储需求将保持快速增长。通用服务器方面,对于DRAM需求,2025年同比增长19%,2026年将继续同比增长20%;对于NANDFlash的需求,2025年同比增长30%,2026年同比增长19%。AI服务器方面,2025年IPDDR需求同比增长67%,RDIMM 同比增长 31%;2026年LPDDR需求同比增长 15%,RDIMM 同比增长 21%。对于NANDFlash需求方面,2025年同比增长60%,2026年将继续增长70%。

而由于存储芯片价格持续上涨,将迫使PC厂商和智能手机提升产品价格,或将抑制客户需求。2025年来自笔记本电脑的需求分别增长14%和3%,2026年将继续分别增长10%和6%;2025年来自智能手机的需求分别增长9%和11%,2026年将继续增长8%和8%。

评论