计算机视觉技术在多领域的应用探究

一、国家政策引领与多领域应用中的核心挑战

近年来,随着人工智能上升为国家战略核心驱动力,国家密集出台政策,为计算机视觉技术多领域深度应用指明方向。中共中央办公厅、国务院办公厅联合印发的《关于推进新型城市基础设施建设打造韧性城市的意见》,明确推动机器视觉、无人智能巡检等技术在城市基础设施运维中的推广;市场监管总局等18部门联合印发的《贯彻实施〈国家标准化发展纲要〉行动计划》,聚焦多领域标准研制,加快视频相关技术标准制定,支持计算机视觉、无人机检测等技术在工业领域集成应用,构建起从技术研发到多领域落地的全链条政策支撑体系。

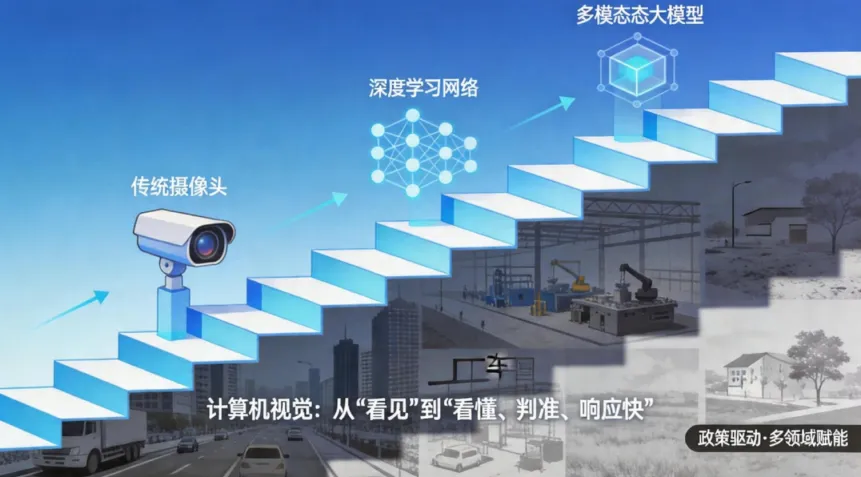

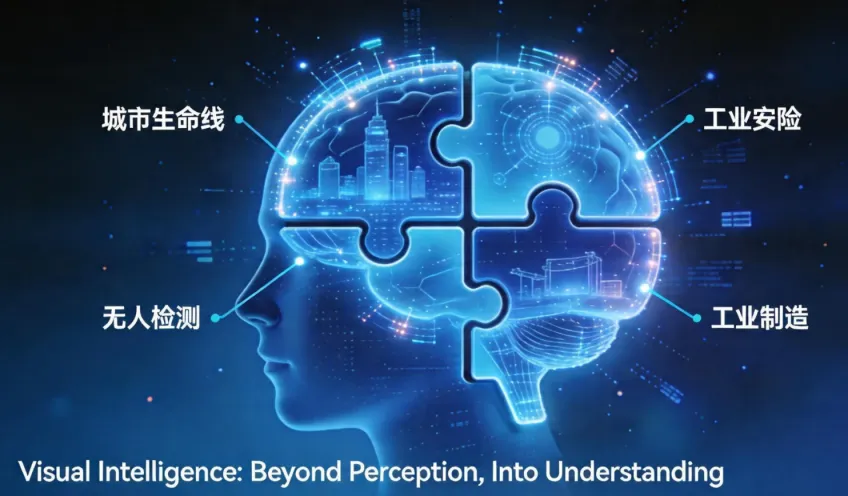

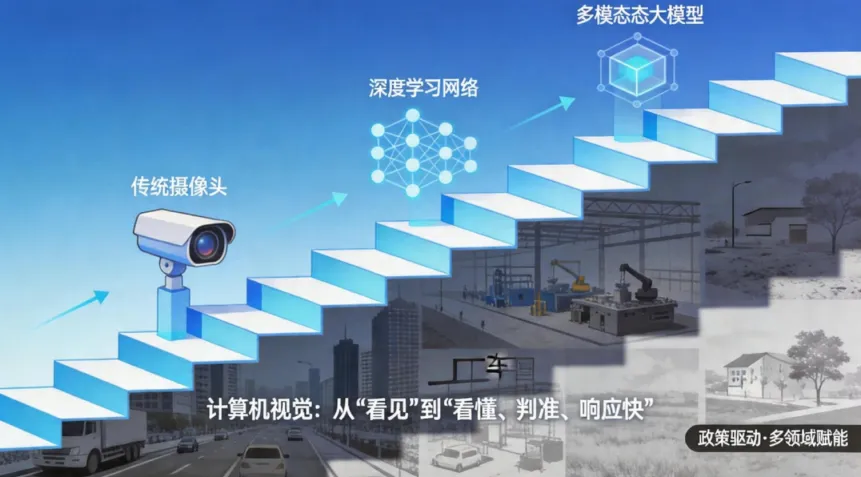

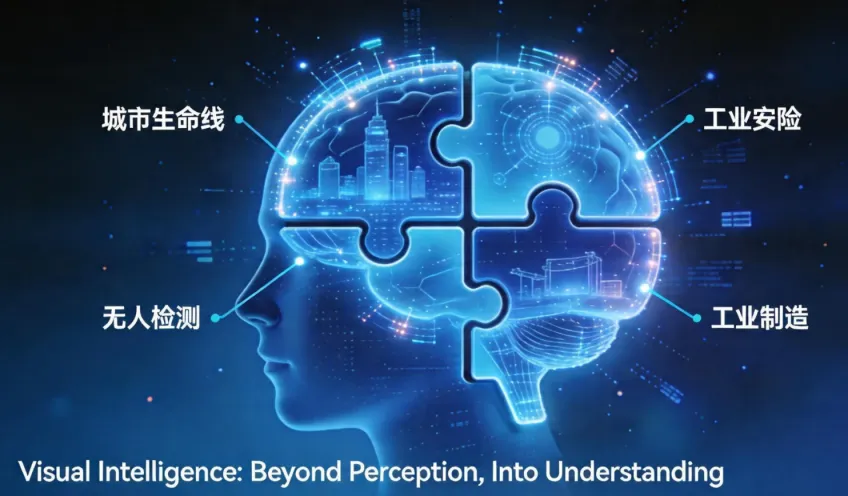

在政策驱动下,计算机视觉技术已突破单一场景局限,广泛渗透到城市生命线、工业安防、无人机检测、工业制造等核心领域,应用覆盖城市供排水管网监测、工业厂区防控、空中巡检、生产线质检等方面。视觉系统已从“看见”向“看懂、判准、快速响应”升级。技术上,视觉智能从传统图像处理、深度学习,快速迭代至多模态大模型阶段,主流技术包括目标检测、分割、分类等,各领域落地各有侧重,但均面临核心挑战:真实场景的复杂性远高于实验室条件,对算法提出更高要求。

图1 计算机视觉演进阶梯图1.1 高可靠性要求

多领域应用对模型均有极高的可靠性要求,任何一次漏检或误报都可能带来严重后果:城市生命线场景中,燃气管道巡检漏检的微小泄漏点可能引发爆炸,桥梁裂缝误判可能导致坍塌;工业安防场景中,漏检厂区内违规动火、易燃易爆物品堆放,或误判设备异常运行状态,可能引发工业火灾、设备损坏事故;无人机检测场景中,漏检输电线路断股、桥梁结构破损,可能导致电力中断、桥梁安全隐患;工业制造场景中,漏检生产部件的细微缺陷、误判产品合格状态,可能造成批量产品报废、生产线停机,甚至影响终端产品安全。尤其在工业高危场景、城市核心设施场景中,模型可靠性更是关乎人员生命财产和生产经营安全,是重中之重。

1.2 环境鲁棒性

环境鲁棒性是模型在多领域落地的核心前提,各领域应用场景均充满不可预知的环境变化:城市生命线场景中,户外管网、桥梁面临雨雪、暴雨、强光、雾霾等干扰,地下管廊存在光线昏暗、粉尘遮挡等问题;工业安防场景中,厂区内高温、高尘、油污、机械振动等环境,会严重影响摄像头采集效果,部分场景还存在电磁干扰;无人机检测场景中,高空强风、云层遮挡、光照剧烈变化,会导致图像模糊、目标位置偏移;工业制造场景中,流水线高速运动带来的运动模糊、车间光线不均匀、部件表面反光等,均会增加感知难度。视觉系统必须依赖算法本身的泛化能力,应对各领域的复杂环境,保障系统在应用场景中的稳定运行。

1.3 视觉理解能力

视觉理解能力成为满足多领域复杂任务需求的关键,单纯的视觉感知已难以适配各领域的专业化需求:城市生命线场景中,不仅要识别管道破损,还要判断破损原因与风险等级;工业安防场景中,不仅要检测违规行为,还要理解行为的危险程度、是否需要紧急联动处置;无人机检测场景中,不仅要识别设施缺陷,还要结合地理信息、设备参数判断缺陷影响范围;工业制造场景中,不仅要检测部件缺陷,还要区分缺陷类型、判断是否影响产品性能。这些任务均涉及视觉信息与各领域业务规则、安全标准、技术参数等多维度知识的融合,对模型的跨模态理解能力提出了更高要求。

图2 视觉理解图二、核心视觉技术及其多领域功能定位

2.1 图像分类:从“看见”到“识别”,适配多领域基础筛查

图像分类作为计算机视觉最基础的任务,核心功能是判断一张图像属于哪个预设类别,接收图像输入后输出所属类别标签,为各领域提供基础的目标识别与筛查能力。在多领域应用中,其功能定位各有侧重:城市生命线场景中,可判断热力管道保温层是否破损、排水口是否堵塞;工业安防场景中,可识别厂区内违规动火、未佩戴安全帽、易燃易爆物品等异常类别;无人机检测场景中,可快速识别输电线路异物、桥梁表面破损、农田病虫害等目标;工业制造场景中,可判断生产部件是否合格、流水线是否存在异物、设备是否处于正常运行状态。图像分类为各领域的后续精细化处理和异常处置提供初步筛选,实现从“看见”到“识别”的跨越,成为多领域视觉应用的基础支撑。

2.2 目标检测:从“识别”到“定位”,提升多领域处置效率

目标检测技术在分类的基础上更进一步,核心功能是在图像或视频中定位感兴趣目标,并识别其类别,不仅能明确“这是什么”,还能精准告知“它在哪里”,为各领域的精准处置提供空间信息支撑。在多领域应用中:城市生命线场景中,可定位燃气管道泄漏点、桥梁裂缝位置、被困人员位置;工业安防场景中,可定位违规动火点、未佩戴防护用品人员、易燃易爆物品、违规闯入人员的具体位置;无人机检测场景中,可定位输电线路断股位置、桥梁破损区域、地面塌陷点位;工业制造场景中,可定位生产部件的缺陷位置、流水线异物位置、设备故障部件位置。目标检测实现了从“识别”到“定位”的提升,大幅提升各领域异常处置、设备运维、质量管控的效率。

2.3 目标分割:从“框定”到“精确定义”,支撑多领域精细化需求

目标分割是比目标检测更精细的视觉任务,核心功能是对图像中的每个像素进行分类,精确勾勒出目标的轮廓边界,与检测模型的矩形框不同,分割模型能描绘目标的不规则形状,实现像素级的精确定位,适配各领域的精细化应用需求。

在多领域实际应用中:城市生命线场景中,可精确分割桥梁裂缝、路面塌陷、管道锈蚀的具体范围,辅助判断隐患等级;工业安防场景中,可精确分割厂区内违规区域、危险物品轮廓、设备异常部位,区分正常区域与异常区域;无人机检测场景中,可精确分割输电线路断股、杆塔破损、植被遮挡线路的范围,为运维提供精准数据;工业制造场景中,可精确分割生产部件的缺陷轮廓、尺寸偏差区域,精准测量缺陷大小,辅助质量分级与整改。目标分割实现了从“框定”到“精确定义”的突破,为各领域的精细化运维、质量管控、安全防控提供精准数据支撑。

2.4 目标追踪:从“单帧”到“连续”,实现多领域时序监测

目标追踪技术的核心功能是在视频序列中为每个目标分配唯一的身份标识,并持续跟踪其运动轨迹,能够回答“这个目标从哪里来、到哪里去、经过了哪些地方”等时空连续性问题,为各领域的时序监测、动态处置提供支撑。

在多领域应用中:城市生命线场景中,可跟踪施工人员移动轨迹、积水区域蔓延轨迹,判断是否存在违规操作、风险扩散;工业安防场景中,可跟踪违规人员、违规车辆的移动轨迹,判断是否存在恶意破坏、违规闯入等行为,及时预警安全风险;无人机检测场景中,可跟踪空中异常目标、地面移动隐患(如滑坡、洪水)的轨迹,辅助应急调度;工业制造场景中,可跟踪流水线部件的运动轨迹,判断是否存在运动偏差、卡顿等异常,保障生产线稳定运行。

2.5 多模态大模型解析技术:赋能多领域智能决策

多模态大模型通过大规模预训练与跨模态对齐,具备了融合视觉、语言等多维度信息进行综合理解、推理与生成的能力。是能够同时处理并理解多种异构数据(如文本、图像、视频、语音、传感器数据等)的人工智能模型。

图3 视觉感知决策图多模态大模型解析技术与小模型形成互补,是对小模型“在哪里、是什么”能力的延伸与升华。小模型负责各领域的基础感知与定位,而多模态大模型则聚焦于融合视觉与语言、数据等多维度信息,深度理解认知“这意味着什么、该如何响应”,适配城市生命线、工业安防、工业制造、无人机检测等多领域的复杂运维和应急处置需求。

在视觉语言理解层面,模型能够同步处理各领域的图像、视频与文本输入(如设施运维标准、工业安全规范、产品质量标准),实现跨模态对齐。一方面,视觉问答功能可满足各领域专业化需求:城市生命线运维人员可提问“管道破损是否会引发路面塌陷”,工业安防人员可提问“厂区动火行为是否符合安全规范”,工业制造人员可提问“部件缺陷是否影响产品性能”,模型结合视觉信息与专业标准予以精准回答。另一方面,图像或视频描述生成功能可自动输出场景详情,如“某化工园区有人员违规动火,周边存在易燃易爆物品”“某生产线部件存在细微裂纹”,辅助相关人员快速掌握现场情况。

自然语言交互式分析进一步突破了传统视觉系统的局限,各领域工作人员无需编写代码或配置规则,仅凭日常语言即可描述分析需求:工业安防人员可下达“排查厂区所有易燃易爆物品堆放点”,无人机检测人员可指令“检测某段输电线路是否存在断股”,工业制造人员可要求“筛查流水线所有不合格部件”,模型可自动完成分析并输出结果,大幅降低应用门槛,提升工作效率。

三、总结

在国家政策的有力推动下,计算机视觉技术正加速向城市生命线、工业安防、无人机检测、工业制造等多个领域深度渗透,已成为推动各领域智能化升级、提升安全防控与生产效率的核心驱动力。从技术发展来看,视觉智能已从单一的算法能力竞赛,转向针对多领域场景约束的系统化优化,聚焦各领域的监测、预警、处置、管控等核心需求,实现技术与场景的深度融合。

未来,随着边缘算力的持续提升、模型压缩技术的进步、多模态对齐方法的成熟以及无人机技术的迭代,各类视觉技术将走向更深度的融合,端云协同架构将更加普及,最终构建起适配多领域、全场景的智能视觉应用体系,为城市安全运行、工业安全生产、高质量制造提供坚实的技术支撑,推动各领域治理体系和生产效能的现代化升级。

- 本文由 chengsenw 发表于 2026年4月18日 13:33:30

- 转载请务必保留本文链接:https://www.gewo168.com/56502.html

评论